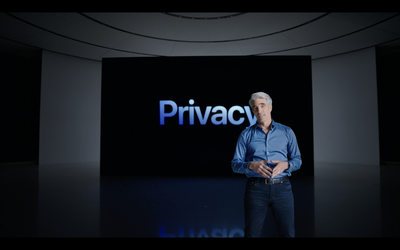

Старший вице-президент Apple по разработке программного обеспечения Крейг Федериги сегодня защитил спорные планируемые компанией функции безопасности детей в рамках важного интервью изданию The Wall Street Journal, раскрыв ряд новых деталей о мерах защиты, встроенных в систему Apple для сканирования библиотек фотографий пользователей на предмет материалов, связанных с сексуальным насилием над детьми (CSAM).

Федериги признал, что Apple плохо представила объявление о двух новых функциях на прошлой неделе, касающихся обнаружения откровенного контента в сообщениях для детей и материалов CSAM, хранящихся в iCloud Фото, и признал широкую путаницу вокруг этих инструментов:

Совершенно ясно, что многое было очень сильно искажено в плане понимания. Мы хотели бы, чтобы это было представлено более ясно для всех, потому что мы очень позитивно и твердо относимся к тому, что делаем.

[…]

Оглядываясь назад, одновременное внедрение этих двух функций стало предвестником такого рода путаницы. Выпустив их одновременно, люди технически связали их и очень испугались: что происходит с моими сообщениями? Ответ… ничего не происходит с вашими сообщениями.

Функция «Безопасность коммуникаций» означает, что если дети отправляют или получают откровенные изображения через iMessage, они будут предупреждены перед просмотром, изображение будет размыто, и у родителей будет возможность получить уведомление. Сканирование CSAM, с другой стороны, пытается сопоставить фотографии пользователей с хешированными изображениями известных материалов CSAM до их загрузки в iCloud. Аккаунты, в которых был обнаружен CSAM, затем подлежат ручной проверке Apple и могут быть переданы в Национальный центр пропавших и эксплуатируемых детей (NCMEC).

Новые функции подверглись большой критике со стороны пользователей, специалистов по безопасности, Electronic Frontier Foundation (EFF) и Эдварда Сноудена, бывшего начальника службы безопасности Facebook и даже сотрудников Apple.

На фоне этой критики Федериги затронул одну из основных проблем, подчеркнув, что система Apple будет защищена от злоупотреблений со стороны правительств или других третьих сторон благодаря «множественным уровням проверяемости».

Федериги также раскрыл ряд новых деталей о мерах защиты системы, например, тот факт, что пользователю необходимо иметь около 30 совпадений с контентом CSAM в своей Фото библиотеке, прежде чем Apple будет уведомлена, после чего она подтвердит, действительно ли эти изображения являются настоящими случаями CSAM.

Если и только если вы достигнете порога примерно в 30 совпадений с известными детскими порнографическими изображениями, только тогда Apple узнает что-либо о вашем аккаунте и об этих изображениях, и в этот момент она будет знать только об этих изображениях, а не о каких-либо других ваших изображениях. Это не анализ того, было ли у вас фото вашего ребенка в ванне? Или, впрочем, было ли у вас фото какой-либо другой порнографии? Это буквально сопоставление только с точными отпечатками конкретных известных детских порнографических изображений.

Он также отметил преимущество безопасности размещения процесса сопоставления непосредственно на iPhone, а не на серверах iCloud.

Поскольку это происходит на [телефоне], специалисты по безопасности постоянно могут анализировать то, что происходит в программном обеспечении [телефона] Apple. Так что, если будут внесены какие-либо изменения, расширяющие область применения этого каким-либо образом — таким образом, что мы обязались не делать — существует проверяемость, они могут заметить, что это происходит.

На вопрос о том, может ли база данных изображений, используемая для сопоставления контента CSAM на устройствах пользователей, быть скомпрометирована путем вставки других материалов, таких как политический контент в определенных регионах, Федериги объяснил, что база данных создается из известных изображений CSAM от нескольких организаций по обеспечению безопасности детей, причем как минимум две из них находятся «в разных юрисдикциях», чтобы защитить систему от злоупотреблений.

Эти организации по защите детей, а также независимый аудитор смогут проверить, что база данных изображений состоит только из контента от этих организаций, по словам Федериги.

Интервью Федериги является одной из крупнейших PR-кампаний Apple после неоднозначной общественной реакции на объявление функций безопасности детей, но компания также неоднократно пыталась ответить на опасения пользователей, опубликовав FAQ и напрямую отвечая на опасения в интервью СМИ.