Apple добавила еще один инструмент в свой растущий репертуар ИИ, создав инструмент, который использует большие языковые модели (LLM) для анимации статических изображений на основе текстовых подсказок пользователя.

Apple описывает это нововведение в новой исследовательской работе под названием «Keyframer: расширение возможностей дизайна анимации с помощью больших языковых моделей».

«Хотя интерфейсы одноразовых подсказок распространены в коммерческих системах преобразования текста в изображения, таких как Dall·E и Midjourney, мы утверждаем, что для анимации требуется более сложный набор соображений пользователя, таких как время и координация, которые трудно полностью указать в одном подсказке — таким образом, альтернативные подходы, позволяющие пользователям итеративно создавать и уточнять сгенерированные дизайны, могут потребоваться, особенно для анимации.

«Мы объединили новые принципы дизайна для подсказок на естественном языке для артефактов дизайна с возможностями генерации кода LLM, чтобы создать новый инструмент анимации на базе ИИ под названием Keyframer. С помощью Keyframer пользователи могут создавать анимированные иллюстрации из статических 2D-изображений с помощью подсказок на естественном языке. Используя GPT-4 3, Keyframer генерирует CSS-код анимации для оживления входного масштабируемого векторного изображения (SVG).»

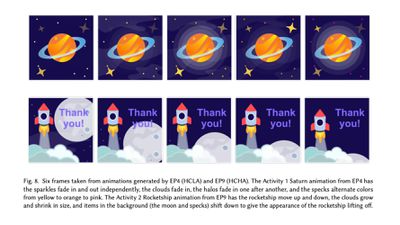

Чтобы создать анимацию, пользователь загружает изображение SVG — скажем, космическую ракету — затем вводит подсказку, такую как «создать три дизайна, где небо плавно переходит в разные цвета, а звезды мерцают». Keyframer затем генерирует CSS-код для анимации, а затем пользователь может уточнить его, отредактировав код напрямую или введя дополнительные текстовые подсказки.

«Keyframer позволил пользователям итеративно уточнять свои дизайны с помощью последовательных подсказок, вместо того чтобы рассматривать весь дизайн заранее», — объясняют авторы. «С помощью этой работы мы надеемся вдохновить будущие инструменты дизайна анимации, которые сочетают мощные генеративные возможности LLM для ускорения прототипирования дизайна с динамическими редакторами, позволяющими создателям сохранять творческий контроль».

Согласно статье, исследование основывалось на интервью с профессиональными дизайнерами анимации и инженерами. «Я думаю, это было намного быстрее, чем многие вещи, которые я делал», — сказал один из участников исследования, цитируемый в статье. «Я думаю, что сделать что-то подобное раньше заняло бы часы».

Это новшество является лишь последним в серии прорывов Apple в области ИИ. На прошлой неделе исследователи Apple выпустили модель ИИ, которая использует возможности мультимодальных LLM для выполнения редактирования изображений на уровне пикселей.

В конце декабря Apple также сообщила, что добилась успехов в развертывании LLM на iPhone и других устройствах Apple с ограниченной памятью, изобретя инновационную технику использования флэш-памяти.

И The Information, и аналитик Джефф Пу заявили, что Apple предоставит некоторую функцию генеративного ИИ на iPhone и iPad позже в этом году, когда выйдет iOS 18. По имеющимся данным, следующая версия мобильного программного обеспечения Apple будет включать улучшенную версию Siri с функциональностью генеративного ИИ, аналогичной ChatGPT, и имеет потенциал стать «самым большим» обновлением в истории iPhone, по словам журналиста Bloomberg Марка Гурмана.

(По материалам VentureBeat.)